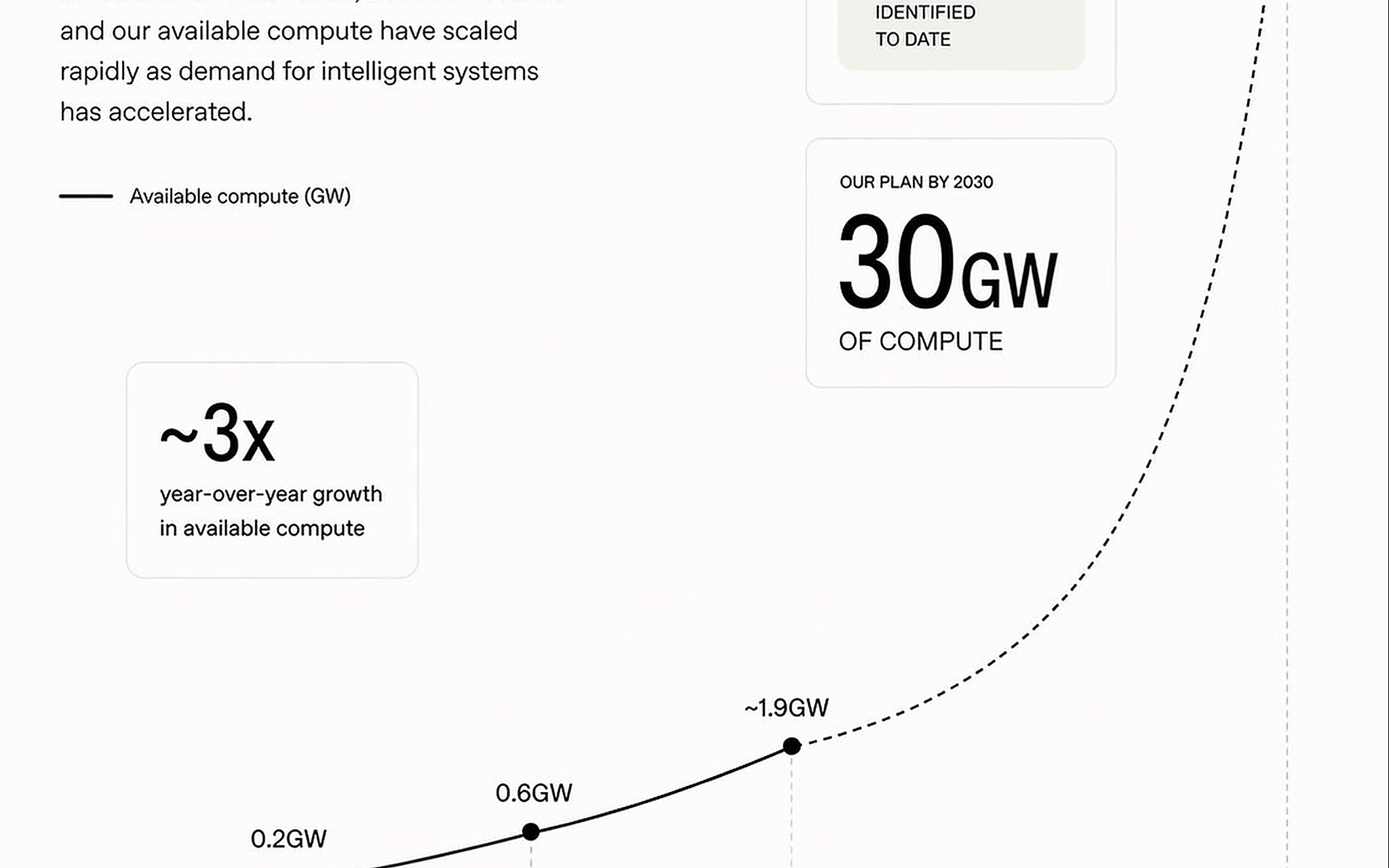

OpenAI 30GW AI compute là mục tiêu mới cho giai đoạn tới năm 2030, và điều đáng chú ý nằm ở quy mô hạ tầng phía sau con số này chứ không chỉ ở tham vọng của riêng một công ty. Theo bài WCCFtech, OpenAI đang hướng tới mốc 30GW năng lực tính toán AI, cao hơn rất nhiều so với mức khoảng 1,9GW mà hãng vận hành trong năm 2025. Đây là cú nhảy gần 16 lần, cho thấy AI giờ là cuộc đua xây “nhà máy tính toán” hơn là chỉ viết mô hình tốt hơn. Với người dùng phổ thông, điều đó có nghĩa chatbot và dịch vụ AI trong vài năm tới sẽ phụ thuộc nhiều hơn vào điện, chip và data center.

30GW lớn ở chỗ nào khi nhìn từ điện, chip và số máy chủ phải dựng thêm?

Điểm đầu tiên cần hiểu là 30GW ở đây không phải kiểu nâng cấp thêm vài cụm GPU, mà là mở rộng hạ tầng ở cấp độ công nghiệp. OpenAI đang muốn đi từ khoảng 1,9GW năm 2025 lên 30GW vào năm 2030. So với kế hoạch 6GW mà Amazon và Anthropic nhắm tới vào cuối năm nay, mục tiêu này vẫn cao hơn rất xa.

Phần khó nhất nằm ở chỗ AI compute không thể tăng chỉ bằng cách đặt mua thêm chip. Để tiến gần mốc 30GW, OpenAI và các đối tác sẽ cần thêm GPU hoặc chip AI chuyên dụng, thêm HBM đang khan hiếm, thêm mạng tốc độ cao, cùng điện và làm mát đủ lớn để ghép cả cụm máy khổng lồ thành một hệ thống thống nhất.

Điều này cũng giải thích vì sao OpenAI phải nghĩ như một nhà vận hành hạ tầng hơn là chỉ một phòng nghiên cứu mô hình. Khi quy mô tăng lên hàng chục gigawatt, mỗi quyết định về địa điểm đặt data center, nguồn điện dự phòng và chuỗi cung ứng bộ nhớ đều có thể làm chậm cả kế hoạch nhiều quý. Nói cách khác, 30GW là bài toán xây hệ thống công nghiệp, không chỉ là mua thêm GPU.

Vì thế, mốc 30GW nói nhiều về sức ép lên chuỗi cung ứng hơn là một màn phô diễn tham vọng. Bài về Fairwater của Microsoft trên Technology Spot cũng cho thấy khi số GPU tăng lên rất lớn, câu hỏi quan trọng không còn là một con chip nhanh đến đâu, mà là cả hệ thống có đủ điện, đủ băng thông và đủ ổn định hay không.

Mục tiêu này sẽ đẩy cuộc đua AI sang hướng nào từ nay tới 2030?

Tác động rõ nhất là cuộc đua AI sẽ ngày càng giống cuộc đua hạ tầng nặng. Mô hình tốt vẫn quan trọng, nhưng nếu không có đủ cụm máy để huấn luyện và chạy suy luận cho hàng trăm triệu người dùng, lợi thế phần mềm sẽ khó chuyển thành doanh thu thật. AI vì vậy đang dịch nhanh sang cuộc chơi của data center, điện và nguồn chip.

| Mốc | Con số đáng chú ý | Ý nghĩa dễ hiểu |

|---|---|---|

| OpenAI năm 2025 | ~1,9GW | Quy mô nền hiện tại để so sánh với mục tiêu mới. |

| Cam kết trước đó | 10GW, đã xác định hơn 8GW | OpenAI đã đi trước một bước trong việc giữ chỗ hạ tầng. |

| Mục tiêu mới tới 2030 | 30GW | Cho thấy nhu cầu AI tương lai được dự báo cao hơn rất nhiều. |

| Amazon + Anthropic | 6GW vào cuối năm nay | Là thước đo để thấy OpenAI đang nhắm quy mô lớn hơn đáng kể. |

Nếu mục tiêu này được giữ đúng tiến độ, áp lực sẽ dồn mạnh hơn lên NVIDIA và các hãng bộ nhớ cao cấp. Bài Jensen Huang trên site từng nhấn mạnh rằng NVIDIA không chỉ bán GPU, mà đang bán cả một nền tảng tăng tốc. Trong bối cảnh OpenAI nhắm 30GW, lợi thế đó càng có giá trị vì khách hàng giờ mua cả một hệ thống AI hoàn chỉnh chứ không chỉ mua chip rời.

Ở chiều ngược lại, người dùng bình thường cũng có lý do để theo dõi mốc này. Hạ tầng AI lớn hơn có thể giúp chatbot phản hồi nhanh hơn và ổn định hơn, nhưng đi kèm là áp lực lớn hơn lên điện, xây dựng và giá linh kiện. Với thị trường, OpenAI 30GW AI compute chưa phải thành tựu đã hoàn thành, mà là tín hiệu cho thấy tới năm 2030, bên dẫn đầu AI nhiều khả năng sẽ là bên dựng được nhiều compute nhất và vận hành nó hiệu quả nhất.