Nvidia đang chỉ ra con đường mới cho hạ tầng trung tâm dữ liệu, khi quy mô huấn luyện AI ngày càng lớn đặt tới hàng chục nghìn GPU hoạt động đồng thời. Vào năm 2026, các nền tảng rack-scale AI thế hệ tiếp theo của Nvidia sẽ chỉ sử dụng quang học đồng gói (co-packaged optics – CPO), thay thế cho các module quang rời truyền thống. Đây là bước chuyển đổi mang tính kiến trúc nhằm đối phó với yêu cầu bàn thảo dữ liệu khổ lượng cao và độ trễ cực thấp trong môi trường AI hiện đại.

Tối ưu hóa kết nối AI với quang học đồng gói

Trong các cụm AI quy mô lớn, các server tại nhiều tủ rack cần hoạt động như một khối thống nhất. Tuy nhiên, với tốc độ truyền đạt 800 Gb/s, dây đồng truyền thống không còn đủ đáp ứng do giới hạn khoảng cách và sự suy hao tín hiệu. Trong khi đó, việc dùng module quang rời khiến mỗi cổng giao tiếp ngào tốn đến 30W điện, đồng thời gia tăng nhiệt và rủi ro hỏng hóc.

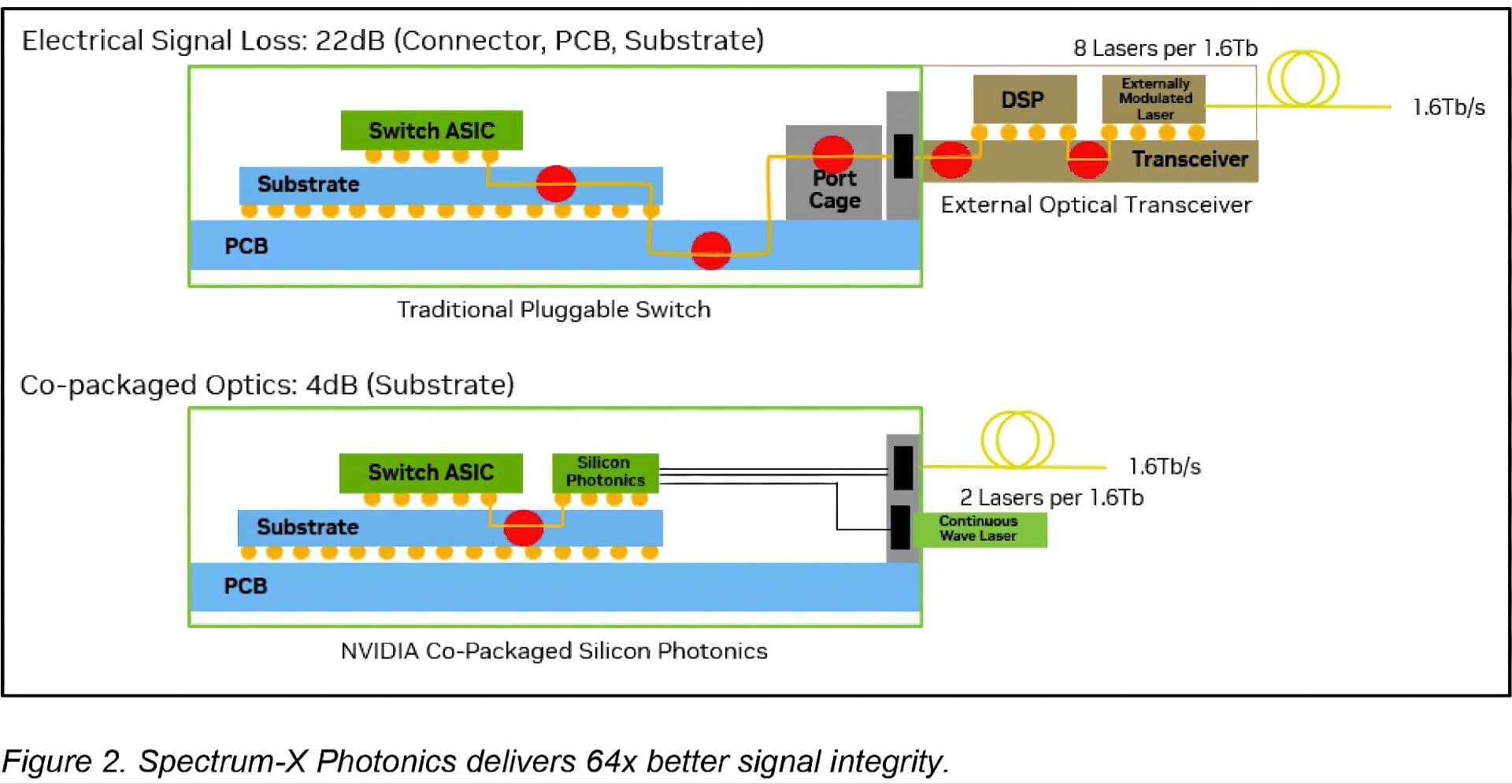

Giải pháp CPO tựa như là cứu cánh. Bằng cách đóng gói đồng thời chip quang và chip switch trong một module, Nvidia giảm thiểu suy hao tín hiệu chỉ còn 4 dB, giúc giảm mức tiêu thụ điện mỗi cổng xuống còn 9W. Ngoài ra, số lượng linh kiện gắn ngoài cũng được tối giản.

Bằng việc áp dụng nền tảng COUPE của TSMC, Nvidia sẽ triển khai 3 giai đoạn. Giai đoạn đầu giới thiệu module quang 1.6 Tb/s; giai đoạn hai đạt 6.4 Tb/s nhờ CoWoS; và đỉnh điểm là tích hợp hoàn toàn quang học vào vi xử lý để hướng tới 12.8 Tb/s.

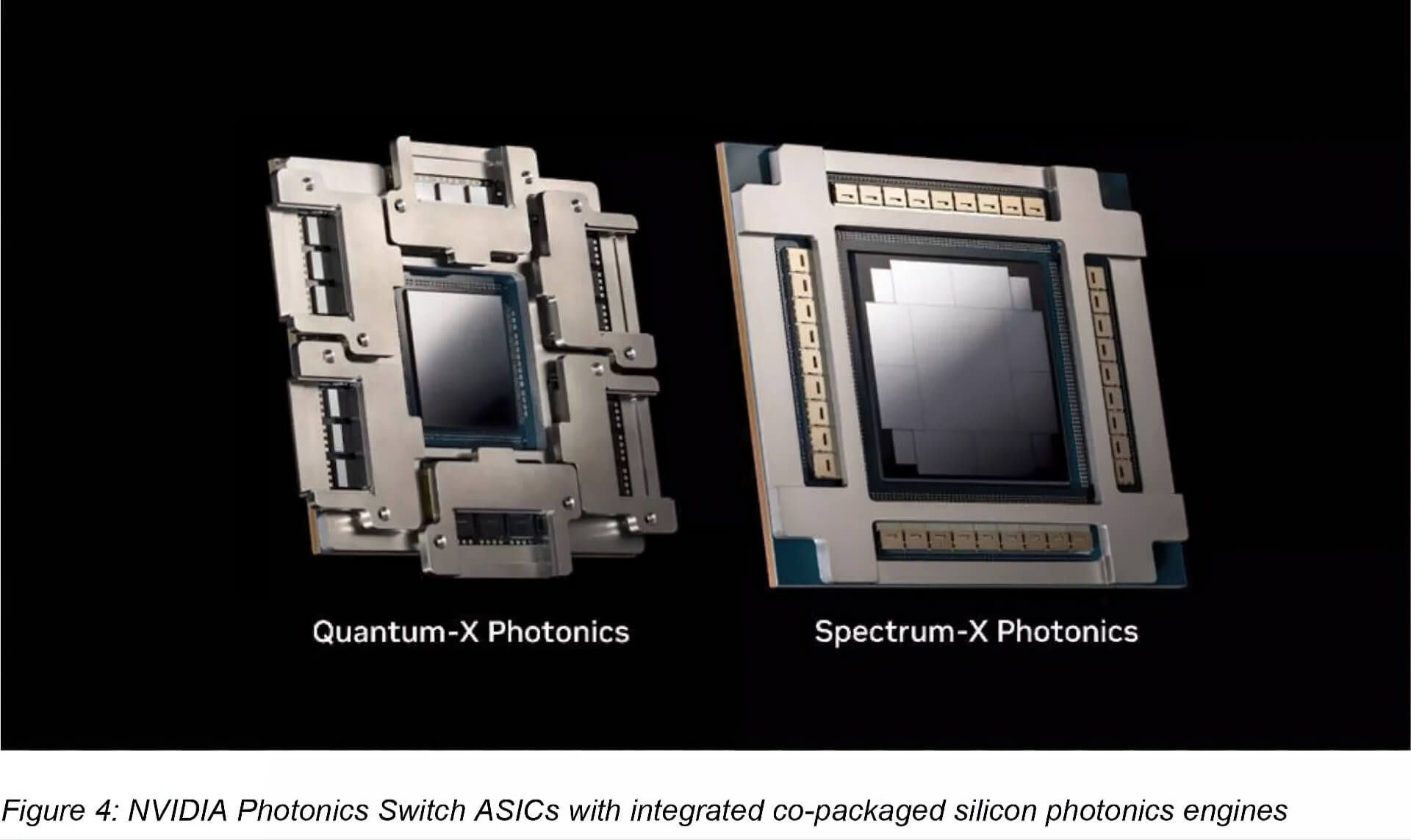

Ra mắt nền tảng Nvidia Quantum-X và Spectrum-X Photonics

Trên phía InfiniBand, Nvidia sẽ ra mắt switch Quantum-X vào đầu năm 2026. Mỗi thiết bị cung cấp tốc độ truyền đạt 115 Tb/s qua 144 cổng 800 Gb/s, tích hợp khả năng xử lý trong mạng 14.4 teraflops. Các switch này sẻ dùng SHARP thế hệ 4 và lạm mát bằng chất lỏng.

Tới cuối năm 2026, Nvidia sẽ mở rộng sang Ethernet với Spectrum-X Photonics. Sản phẩm dựa trên chip Spectrum-6 với 2 tùy chọn: SN6810 (đạt 102.4 Tb/s, 128 cổng) và SN6800 (đạt 409.6 Tb/s, 512 cổng). Tất cả các thiết bị đều được làm mát bằng chất lỏng.

Nvidia nhấn mạnh rằng việc áp dụng quang học đồng gói không còn là tùy chọn, mà đã trở thành yêu cầu kiến trúc thiết yếu để xây dựng các siêu cụm AI với hàng chục nghìn GPU. Chiến lược này cũng đặt ra thách thức cho các đối thủ, khi AMD đã mua lại startup quang học Enosemi để theo kịp Nvidia trong cuộc đua kết nối bằng “ánh sáng”.

Nhờ sự hợ trợ của TSMC và lộ trình COUPE, Nvidia hy vọng mang lại động lực và sự đồng bộ trong toàn bộ hệ sinh thái AI thế hệ mới.