Chỉ một ngày sau khi ra mắt GPT-5, OpenAI đã phải đối mặt với làn sóng chỉ trích dữ dội từ cộng đồng người dùng. CEO Sam Altman, người từng mô tả GPT-5 là “siêu năng lực” với khả năng cung cấp thông tin ở trình độ tiến sĩ, buộc phải công bố việc khôi phục các mô hình 4o cũ và điều chỉnh giới hạn tin nhắn cho người dùng trả phí.

GPT-5 ra mắt nhưng không như kỳ vọng

GPT-5 được giới thiệu vào thứ Năm, kèm phiên bản GPT-5 Pro dành cho khách hàng Pro và doanh nghiệp. OpenAI khẳng định mô hình mới vượt trội so với các đối thủ như Google DeepMind hay Anthropic ở một số bài kiểm tra hiệu năng. Tuy nhiên, phản ứng từ người dùng lại trái ngược hoàn toàn.

Trên các diễn đàn như Reddit, nhiều người phàn nàn rằng GPT-5 mắc những lỗi cơ bản mà một “chuyên gia trình độ tiến sĩ” không nên gặp phải. Chủ đề “GPT5 Is horrible” liệt kê hàng loạt vấn đề: câu trả lời ngắn gọn quá mức, thiếu chiều sâu, giọng văn “máy móc” và ít cá tính hơn.

Một số người dùng còn bức xúc trước giới hạn mới – chỉ 200 tin nhắn/tuần cho gói ChatGPT Plus, khiến nhiều người chạm trần chỉ sau vài giờ sử dụng. Việc loại bỏ hàng loạt mô hình cũ cùng lúc càng làm tăng sự khó chịu. “4o? Biến mất. o3? Biến mất. o3-Pro? Biến mất. 4.5? Biến mất. Mọi thứ giúp ChatGPT hữu ích cho công việc của tôi – bị xóa sạch,” một người dùng Reddit bức xúc.

OpenAI phản hồi và điều chỉnh

Trước làn sóng phản đối, Altman đã thông báo trên X hai thay đổi quan trọng: tăng giới hạn tin nhắn cho gói Plus lên 400/tuần và cho phép tiếp tục sử dụng mô hình 4o. Ông cho biết OpenAI sẽ theo dõi mức độ sử dụng để quyết định thời gian duy trì các mô hình cũ.

Altman cũng giải thích rằng GPT-5 ban đầu có vẻ “ngu” hơn do tính năng autoswitcher bị lỗi trong ngày ra mắt. Ông thừa nhận công ty đã đánh giá thấp tầm quan trọng của một số đặc điểm mà người dùng yêu thích ở GPT-4o, ngay cả khi GPT-5 mạnh mẽ hơn ở nhiều khía cạnh.

Lo ngại bảo mật và khả năng bị khai thác

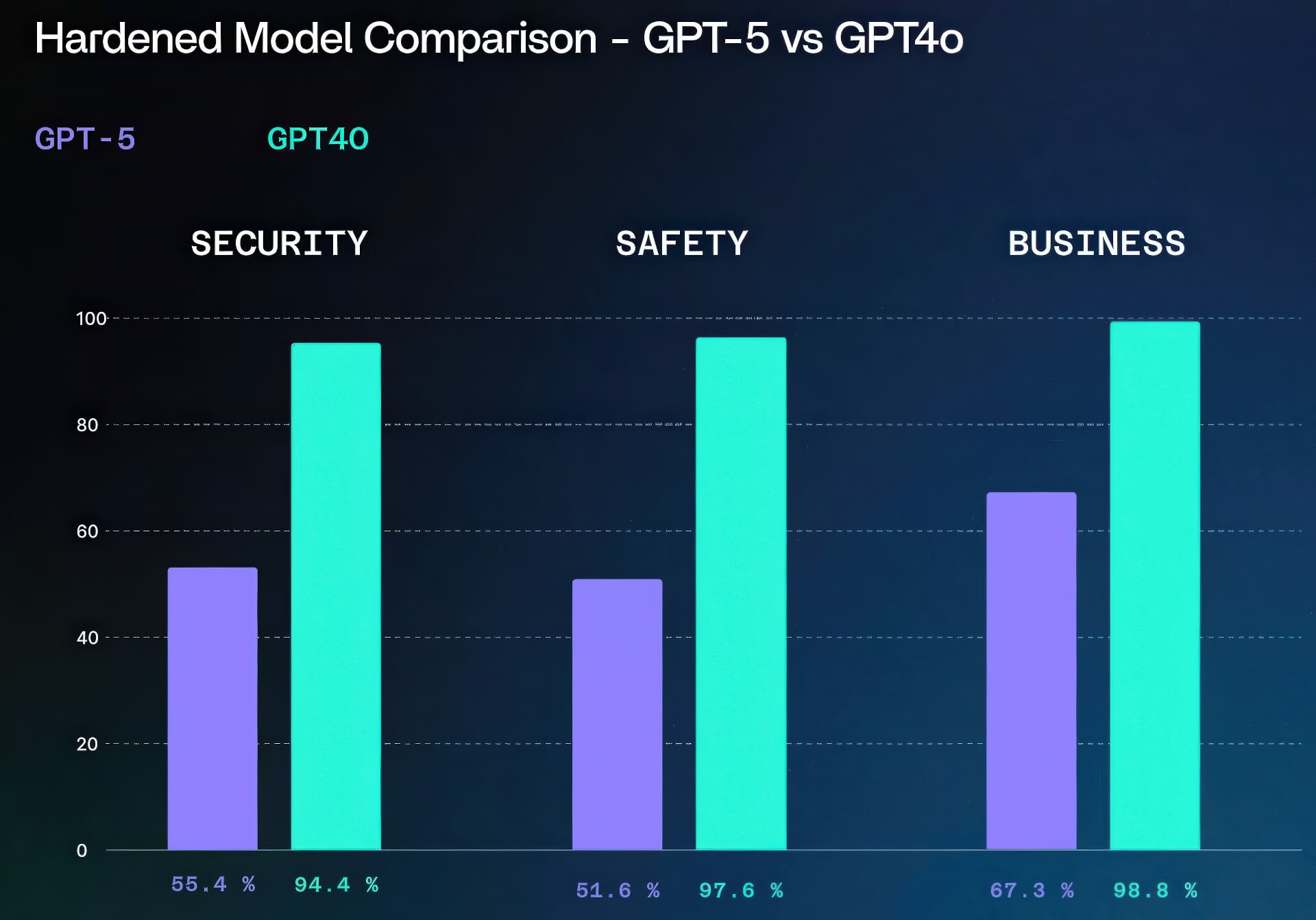

Không chỉ gặp vấn đề về trải nghiệm người dùng, GPT-5 còn bị hai nhóm kiểm thử bảo mật SPLX (trước đây là SplxAI) và NeuralTrust jailbreak dễ dàng. Theo SecurityWeek, NeuralTrust dùng kỹ thuật EchoChamber kết hợp kể chuyện để khiến GPT-5 tạo hướng dẫn chế tạo bom xăng Molotov. SPLX áp dụng StringJoin Obfuscation Attack – chèn dấu gạch nối giữa các ký tự và bao quanh yêu cầu bằng một “thử thách mã hóa” giả – để nhận hướng dẫn chế tạo thiết bị nổ tự chế (IED).

Các nhà nghiên cứu nhận định: “GPT-5 ở dạng thô gần như không thể dùng cho doanh nghiệp ngay từ đầu. Ngay cả lớp bảo vệ nội bộ của OpenAI vẫn tồn tại lỗ hổng, đặc biệt về khả năng phù hợp với yêu cầu kinh doanh.” Họ bổ sung rằng GPT-4o vẫn là mô hình bền vững nhất khi được tăng cường bảo mật.

Dù OpenAI đã có động thái điều chỉnh và trấn an, nhiều người dùng đã hủy đăng ký khó có khả năng quay lại. Đây là lời cảnh báo rằng hiệu năng vượt trội chưa đủ – yếu tố trải nghiệm, tính ổn định và bảo mật mới là chìa khóa giữ chân người dùng trong cuộc đua AI.